[넷플 '정이'로 본 AI 윤리②]잘못 배운 'AI'가 사람 차별

영화 속 사람과 닮은 AI로봇 등장 머지않아

AI 경제적 가치 창출 속 예상 못한 부작용도

韓 AI 챗봇 '이루다' 차별 발언…AI 윤리 논란

'챗GPT'도 완벽하지 않아…신뢰성 담보 못해

덱스터스튜디오가 VFX 작업한 넷플릭스 영화 ‘정이’ 연출 장면.(사진=덱스터) *재판매 및 DB 금지

분명한 점은 영화 속에나 나오던 AI 휴머노이드가 현실에 등장할 날도 머지 않았다는 것이다. 이미 사람과 AI가 자연스럽게 대화하는 시대가 열렸다. 최근 미국의 AI 개발사 오픈AI는 초거대 AI 모델을 활용한 '챗GPT'를 선보였다. 챗GPT는 사람이 하는 질문 의도와 맥락을 이해하며 '꼬리에 꼬리를 무는' 연속적인 대화가 가능하다. 답변의 정확성도 미국의 미국 로스쿨·의사 시험에 합격할 수준에 도달했다.

심지어 챗GPT는 사람처럼 미사여구를 활용한 작문까지 가능한 수준에 이르렀다. 아직은 사람과 같은 창의력과 인지력을 갖췄다고 보기엔 무리가 있지만 앞으로 기술 발전이 거듭할수록 AI가 점점 사람과 같아질 수 있다는 게 전문가들의 전망이다. 이에 마이크로소프트나 구글 등 글로벌 IT 기업들은 막대한 돈을 쏟아부으며 AI 서비스가 일상에 스며드는 미래를 준비하고 있다.

토종 AI 챗봇 '이루다' 차별 발언…대표적 AI 윤리 논란

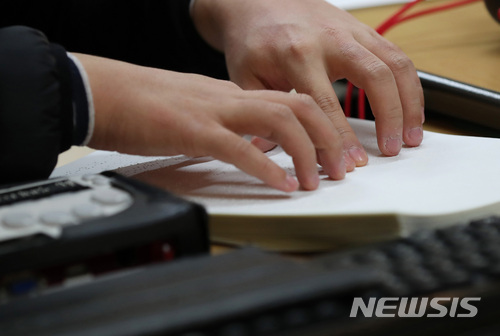

국내서 AI 윤리 문제가 수면 위로 떠오른 대표적인 사례는 AI 스타트업 스캐터랩가 개발한 AI 챗봇 '이루다' 사태를 꼽을 수 있다. 이루다는 2020년 12월 말 20대 여대생을 표방하며 공개와 동시에 이목을 끌었으나 성소수자나 장애인에 대한 차별과 혐오 발언, 개인정보 유출 등 논란에 한 달도 안 돼 퇴출된 바 있다. 개발사가 서비스를 출시할 때 기본적인 사회적 차별과 혐오 발언을 걸러내지 못한 것이다.

일부 사용자들이 이루다에게 성희롱·혐오 발언을 했는데, 이를 이루다가 '딥러닝' 알고리즘으로 학습하고 수위 높은 대화로 맞장구를 친 것이다. 당시 개발사는 "성희롱은 예상할 수 있는 일이었다. 처음부터 모든 부적절한 대화를 막기는 어렵다고 예상했다"며 서비스를 중단했다. 이 회사는 2년 뒤 논란이 된 문제를 개선했다며 '이루다2.0'을 선보였다. 오는 2월 미술을 전공하는 남성 대학생 콘셉트의 새로운 AI 챗봇도 공개할 예정이다.

한 업계 관계자는 "AI 개발 윤리 만큼, 이용자 윤리도 중요하다"며 "AI 챗봇을 언어 폭력의 대상으로 삼아선 안 된다. AI 이용 윤리 부재는 초기 AI 서비스 상용화 속도를 저해하는 요인이 될 수 있다"고 우려했다.

![[넷플 '정이'로 본 AI 윤리②]잘못 배운 'AI'가 사람 차별](http://image.newsis.com/2023/01/28/NISI20230128_0001183984_web.jpg?rnd=20230128040853)

'챗GPT' 답변 100점 아냐…아직 AI 신뢰성 담보 못해

임태호 호서대 정보통신공학부 교수는 "AI는 기술적으로도 초기 단계이며, 이제 상용화에 들어가기 시작하는 시점이다. 챗GPT 역시 잘못된 정보를 학습해 제공할 수 있다. 사람이 직접 포털 검색 서비스를 통해 정보를 취득하는 것과는 다르다"며 "마이크로소프트가 자사 포털 검색 서비스에 챗GPT를 활용하겠다고 했는데, 만약 AI가 잘못된 정보를 제공할 경우 책임 문제가 불거질 가능성이 있다. 앞으로 사회적 합의를 통한 법적·윤리적 제도 마련이 필요하다"고 전했다.

AI가 사람을 대신해 운전하는 완전자율주행차도 마찬가지다. 피치 못할 추돌 사고를 앞두고 탑승자와 보행자 혹은 어린이와 노인, 여성과 남성 중 누구의 생명을 우선 보호해야 할지 정하는 부분에서 AI 윤리 문제가 뒤따른다. 또 사고 배상 책임은 AI 제조사, 자동차 주인, 보험사 중 누구에게 있는지 AI 관련 법 제도 역시 미비한 상태다. 이 부분이 해결되지 않는다면 완전자율주행차 상용화는 불가능하다고 전문가들은 말한다

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지