NYT "AI 언어 무작위 학습보다는 인간 맞춤형 소언어모델 개발해야"

2000억 단어 챗GPT-3 등 이해 불가…인간 위협 우려

13세 인간 수준 1억 단어 학습시켜 효율적으로 개발

인간과 비슷한 방식…뉘앙스 잘 이해하는 AI 개발을

![[보스턴=AP/뉴시스]대언어모델(LLM) 인공지능 기술이 가진 문제점들을 극복하기 위해 대안으로 소언어모델(BabyLM) 인공지능을 개발하자는 운동이 시작됐다. 사진은 지난 3월21일 보스턴에서 촬영된 사진에 오픈AI의 챗GPT가 만들어낸 페이지를 보여주는 컴퓨터 화면. 2023.05.31.](https://img1.newsis.com/2023/05/09/NISI20230509_0000181788_web.jpg?rnd=20230509221848)

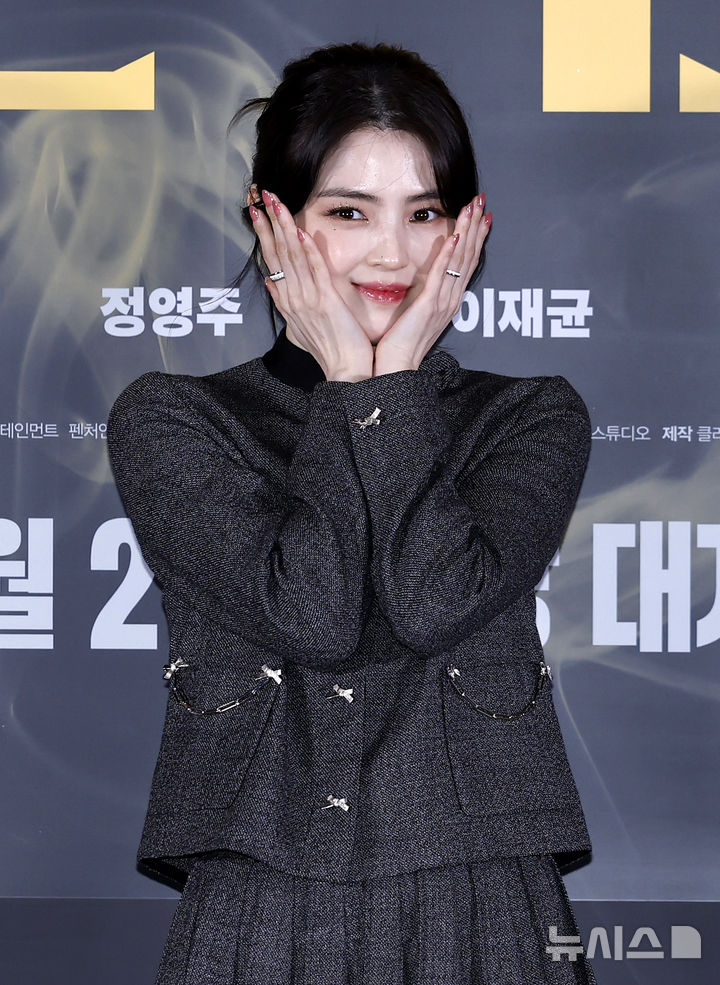

[보스턴=AP/뉴시스]대언어모델(LLM) 인공지능 기술이 가진 문제점들을 극복하기 위해 대안으로 소언어모델(BabyLM) 인공지능을 개발하자는 운동이 시작됐다. 사진은 지난 3월21일 보스턴에서 촬영된 사진에 오픈AI의 챗GPT가 만들어낸 페이지를 보여주는 컴퓨터 화면. 2023.05.31.

[서울=뉴시스] 강영진 기자 = 챗GPT처럼 엄청난 양의 자료를 학습하는 대언어모델(LLM) 인공지능(AI)은 많은 자료를 학습할수록 뛰어난 성능을 발휘한다. 덕분에 구글, 메가, 오픈AI, 마이크로소프트 등 소수 기업들이 거의 전적으로 AI 기술을 지배하고 있다.

나아가 LLM은 인간이 이해할 수 없는 대상이 되기도 한다. AI 설계자도 알지 못하는 “블랙 박스”여서 궁극적으로 인간을 위협할 수도 있다는 우려를 일으킨다. 학습 자료의 규모가 클수록 더 이해하기 어려워진다.

미 뉴욕타임스(NYT)는 30일(현지 시간) 이같은 LLM AI의 문제점을 해소하고 인공지능의 성능을 개선하기 위한 소언어모델(BabyLM) AI 개발 노력을 소개했다. 다음은 기사 요약.

지난 1월 자연어 처리 연구자들이 AI 개발에서 이 같은 패러다임 전환이 이뤄져야 한다고 강조했다. 자연어 처리는 AI가 언어를 이해하도록 하는 분야다. 이들은 LLM이 사용하는 자료의 1만분의 1 이하의 자료를 사용하는 고기능 언어 모델을 만들어야 한다고 요구했다. LLM 못지않게 성능이 우수한 소언어모델을 개발해 보급이 쉽고 보다 인간 친화적인 AI를 만들어야 한다는 주장이다.

소언어모델 개발 주창자인 존스 홉킨스대 컴퓨터 학자 애런 뮐러는 “작게 생각함으로써 더 많은 사람들이 쓸 수 있는 효율적인 시스템을 개발하도록 촉구한다”고 말했다.

공동 주창자 스위스 취리히연방공대의 컴퓨터 학자 알렉스 바르슈타트도 “우리의 문제 제기는 ‘언어 모델을 얼마나 크게 만들 것인가’가 아니라 인간 언어에 대한 학습을 논의의 중심에 두자는 것”이라고 설명했다.

LLM AI는 특정 문장이나 문구에서 다음에 나올 단어를 예측하도록 설계돼 있다. 각종 문서와 웹사이트, 소설, 신문 등에서 수집한 말뭉치들을 학습해 다음에 나올 최적의 단어를 예측해 제시하는 방식이다. 이 과정을 반복함으로써 단어들 사이의 연관관계를 파악하게 되고 더 나은 예측을 할 수 있도록 돼 있다.

따라서 더 많은 자료를 학습할수록 더 좋은 결과를 낼 것으로 예상해 학습자료량이 갈수록 늘어나고 있다. 예컨대 오픈AI의 챗GPT-3는 2000억 단어를 학습했고 딥마인드사의 친칠라는 1조 단어를 학습했다.

노암 촘스키의 자연주의 이론은 인간이 언어를 빠르고 효율적으로 습득하는 것은 언어가 어떻게 작동하는 지를 선천적으로 알기 때문이라는 주장이다. 그러나 LLM AI는 선천적 이해 없이도 언어를 빠르게 배우기 때문에 이 이론이 적용될 수 없다.

이에 따라 뮐러, 바르슈타트 교수 등은 인공지능이 인간과 유사한 방식으로 언어를 학습하도록 유도하는 것이 필요하다고 판단했다. 지난 1월 이들은 인간이 13살이 되도록 접하게 되는 약 1억 개의 단어로 AI를 학습시키는 프로그램을 개발하도록 요청했다. 그렇게 학습한 AI 들 가운데 언어의 미묘한 뉘앙스를 잘 이해하는 AI를 우승자로 선정하겠다는 것이다.

맥길대학교의 언어학자 에바 포르텔란체는 소언어모델이 ‘대언어모델 군비경쟁’에서 한발 비켜서 보다 직관적인 AI를 개발할 수 있다고 평가한다.

오픈AI사의 설립자 샘 앨트먼도 소언어모델 접근 방식을 주목하고 있다. 그는 최근 지금까지와 다르게 학습 자료를 늘리는 만큼 성능이 개선되지 않을 것으로 전망했다. 구글과 메타 같은 회사들도 사람의 인지구조를 모방한 보다 효율적인 인공지능 모델 개발에 투자해왔다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지