과기부, AI 신뢰성 제고 위한 대국민 세미나 개최

AI 개발 안내서·윤리 자율점검표·윤리교육총론 등에 대한 의견 수렴

![[서울=뉴시스]](https://img1.newsis.com/2021/11/23/NISI20211123_0000875768_web.jpg?rnd=20211123110437)

[서울=뉴시스]

인공지능 신뢰성이란 인공지능이 내포한 위험과 기술적 한계를 해결하고, 활용·확산 과정에서의 위험·부작용을 방지하기 위한 가치 기준으로서, 안전, 설명가능, 투명, 견고, 공정 등을 핵심요소로 포함한다.

이번 세미나는 올해 5월 발표한 '신뢰할 수 있는 인공지능 실현전략'의 후속 조치로 준비 중인 인공지능 윤리 자율점검표, 인공지능 개발 안내서(가이드북) 및 인공지능 윤리 교육 총론 초안에 대해 각계의 의견을 폭넓게 수렴하고자 마련됐다.

'인공지능 윤리 자율점검표'는 '인공지능 윤리기준'(2020년 12월)의 3대 원칙 및 10대 핵심 요건을 구체화한 것으로, 기획자, 관리자 등 인공지능 제품·서비스의 기획 과정에 참여하는 주체가 인공지능 윤리 항목들을 자율적으로 확인할 수 있도록 점검 항목을 제공한다.

'인공지능 개발 안내서'(가이드북)는 개발자, 연구자 등이 인공지능 개발 단계에서 참고할 수 있는 기술적 요구사항, 검증 항목·방법 등으로 구성돼 있다.

'인공지능 윤리 교육 총론'은 사회 전반에 인공지능 윤리 의식을 확산하기 위해 교육 목표, 성취 기준, 교수·학습·평가 방향 등 인공지능 윤리 교육 기본 방향을 제시한다. 향후에는 이를 기반으로 초중고 대상별 교육 콘텐츠를 개발할 계획이다.

이번 세미나는 관련 전문 기관에서 준비한 인공지능 윤리 자율 점검표, 인공지능 개발 가이드북, 인공지능 윤리 교육 총론 초안을 중심으로 발표와 전문가들의 토론이 진행됐다.

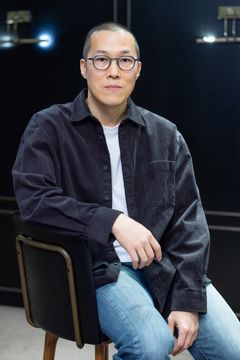

첫 번째 시간에는 정보통신정책연구원 문아람 박사가 '인공지능 윤리기준'(2020년 12월)의 구체적인 실천 방안으로서 인공지능 윤리 자율점검표에 대해 발표했다.

두 번째 시간에는 한국정보통신기술협회 차순일 단장이 인공지능 개발 단계에서 신뢰성 확보를 위해 기술적으로 확인해야 할 요구사항 등을 담은 개발 안내서(가이드북)에 대해 설명했다.

세 번째 시간에는 서울교육대학교 변순용 교수와 정보통신정책연구원 조성은 박사가 인공지능 윤리 교육 총론을 공개, 인공지능 윤리 교육 방향을 제시했다.

이번 세미나는 과기부 유튜브 채널을 통해 생중계됐으며, 온라인을 통한 시민의견 수렴도 진행됐다.

과기부 박윤규 정보통신정책실장은 "사생활 침해, 딥페이크 범죄 등 인공지능이 야기할 수 있는 사회적 문제에 대한 우려가 커지는 상황에서 인공지능 산업 발전을 위해서는 인공지능에 대한 신뢰를 확보하는 것이 반드시 선행돼야 한다"며 "인공지능 생태계에 참여하는 모든 구성원들이 안전하고 신뢰할 수 있는 인공지능을 개발하고 활용할 수 있도록 적극 지원해나가겠다"고 말했다.

◎공감언론 뉴시스 [email protected]

Copyright © NEWSIS.COM, 무단 전재 및 재배포 금지